Versions Compared

Key

- This line was added.

- This line was removed.

- Formatting was changed.

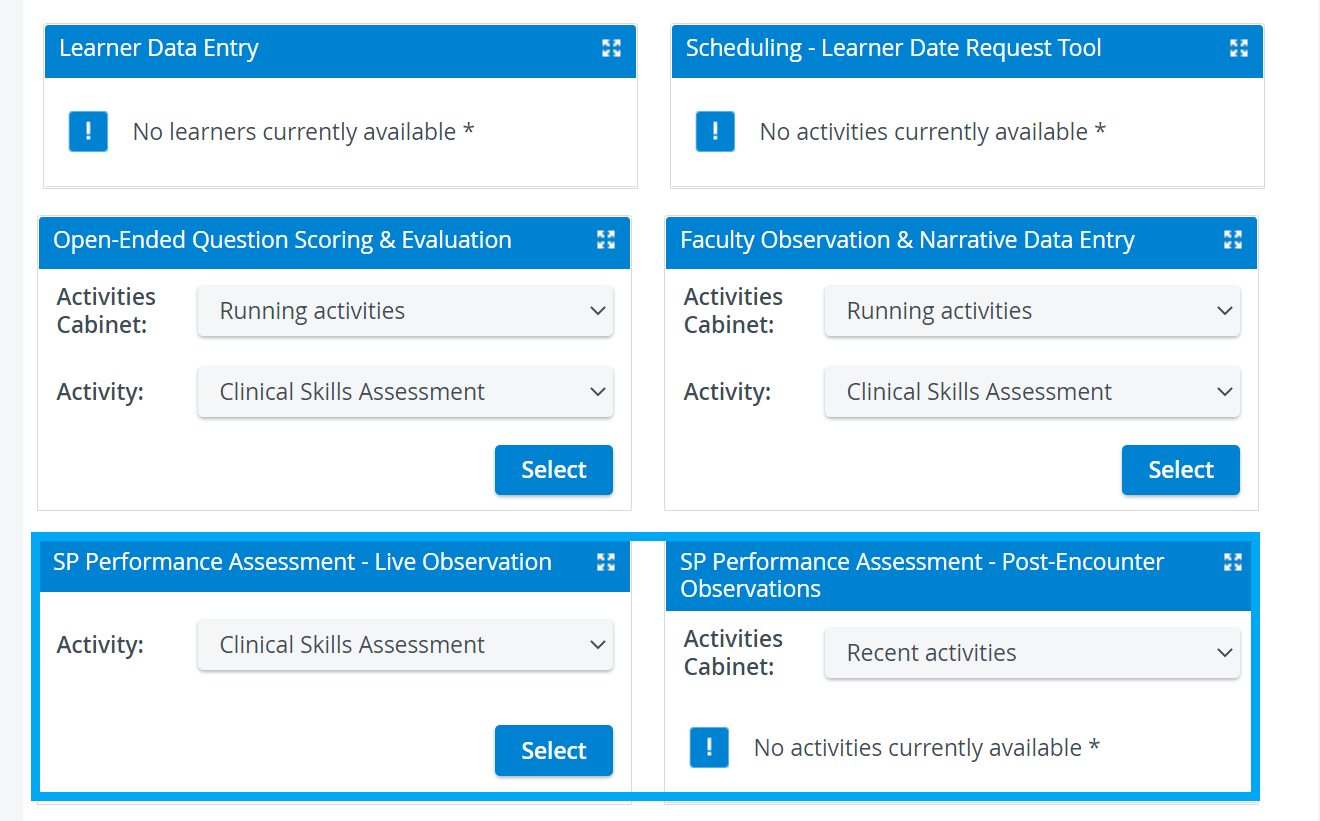

Lors de l'évaluation des PS, l'un des moyens utilisés consiste à faire remplir par un observateur le même questionnaire que celui rempli par le PS, puis à comparer les deux.

| Note |

|---|

Les observateurs peuvent revoir l'enregistrement vidéo des rencontres, s'assurant ainsi de ce que le PS et l'apprenant ont fait pendant la rencontre et de la manière dont ils l'ont effectuée |

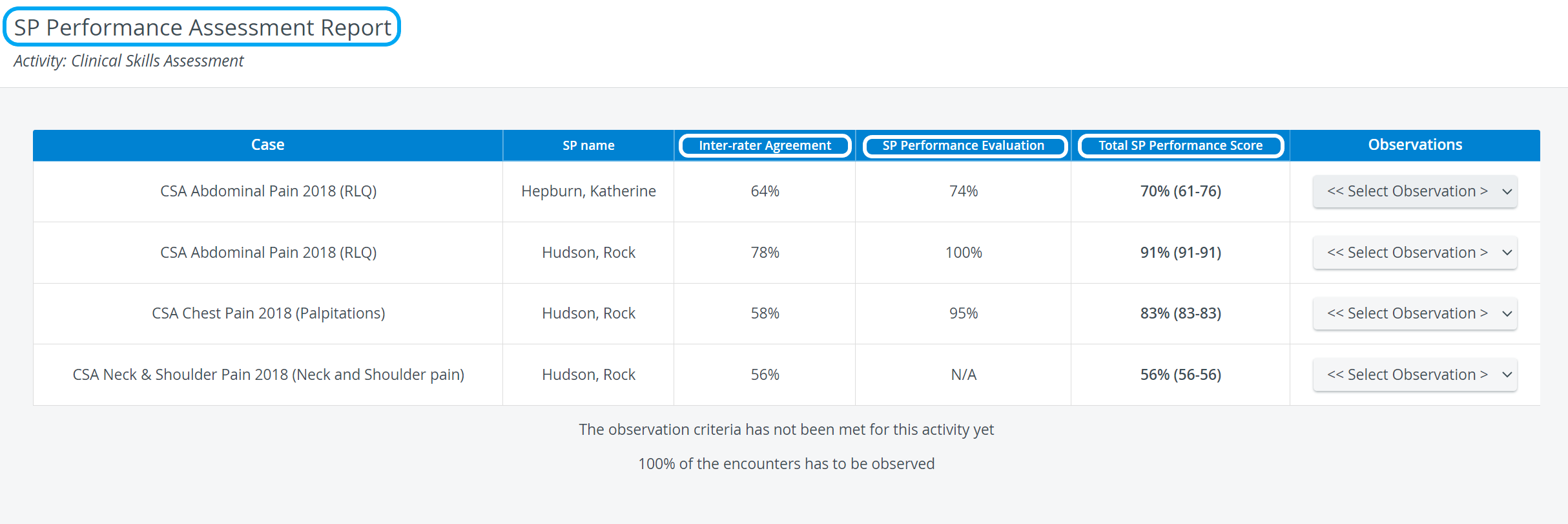

When evaluating SPs, one of the devices for this is for an Observer to fill out the same questionnaire that the SP filled out, then compare the two.

| Note |

|---|

| Observers can review the video recording of encounters, this way making sure of what and how the SP and the learner did during the encounter . |

Image Modified

Image Modified

| Table of Contents |

|---|

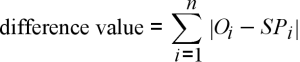

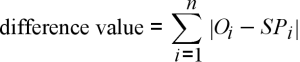

To evaluate the Inter-Rater Agreement, the system calculates the difference value. For an Item, this value is the absolute value of the difference between the value of the answer selected by the SP and the one selected by the Observer. The difference value of the section is the sum of the difference value of the non-open-ended items.

| Note |

|---|

The Difference value is in points, not percentages. |

Image Removed

Image Removed

Oi = value of the answer selected by the observer for an item

SPi = value of the answer selected by the SP for an item

n = number of the items in the SP part of the case

| Info | ||

|---|---|---|

NOTES:

|

Image Removed

Image Removed

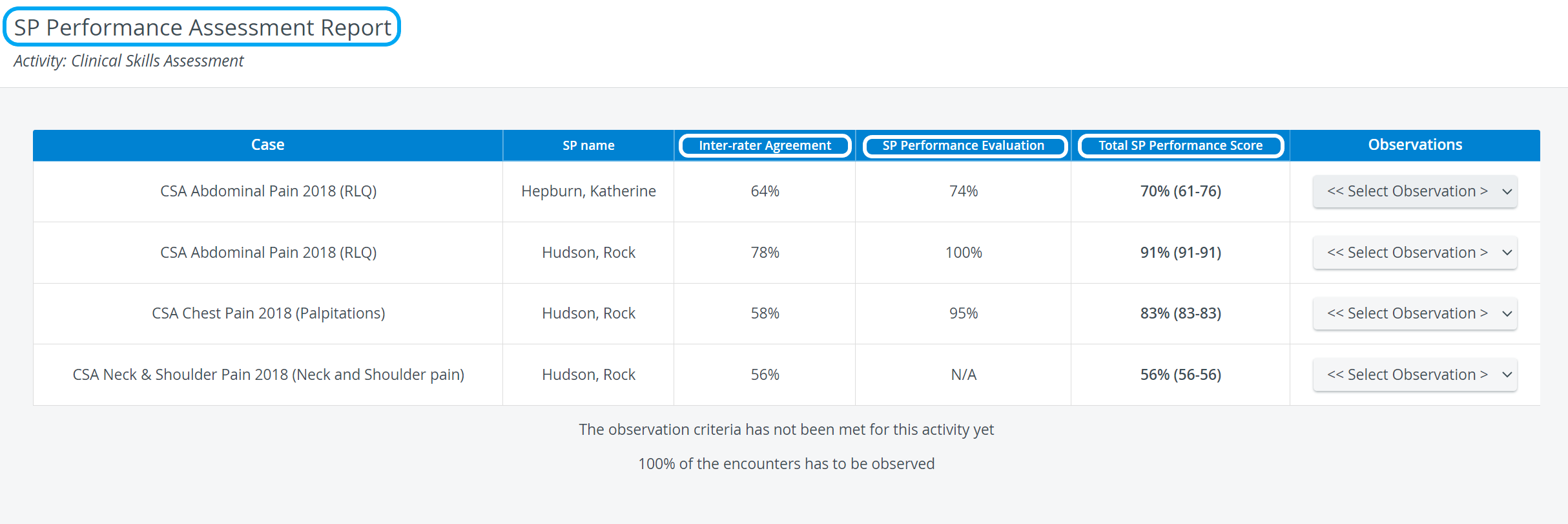

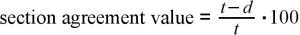

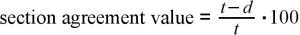

Section Agreement Value

The Difference Value is used for calculating the Section Agreement Value. This percentage value refers to one section of the SP part, and is the difference of the total achievable non-open-ended point value in the section and the difference value, divided by the total achievable point value.

| Info |

|---|

The Section Agreement Value is a percentage value that refers to one section of the SP part: it is the difference of the total achievable non-open-ended point value in the section and the difference value, divided by the total achievable point value. |

Image Removed

Image Removed

t = total achievable non-open-ended point value in the section

d = difference value for the section

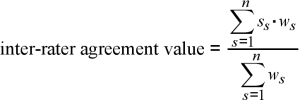

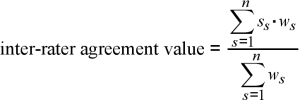

From the section agreement value of each section of the SP part, the system calculates the Inter-Rater Agreement Value: their weighted average using the section weights as set in the Case Manager for learner scoring. This ensures that disagreement about points in more important (hence higher weighted) sections will affect the Total Agreement Value more.

Inter-Rater Agreement Value

Inter-Rater Agreement Value: sum of the products of each Section Agreement Value within one particular SP part, and the corresponding section weight, divided by the sum of the section weights.

Image Removed

Image Removed

ss = section agreement value for each section of the SP part of a certain Case

ws = section weight belonging to each section within the SP part, defined in the Case Manager

n = number of sections in the SP part

Valeur de différence

Pour évaluer l'entente entre évaluateurs, le système calcule la valeur de différence.

Pour un élément, cette valeur est la valeur absolue de la différence entrela valeur de la réponse sélectionnée par le PS et celle sélectionnée par l'observateur.

La valeur de différence de la section est la somme de la valeur de la différence des éléments (questions) non ouverts.

| Note |

|---|

La valeur de la différence est exprimée en points et non en pourcentage. |

Image Added

Image Added

Oi = valeur de la réponse sélectionnée par l'observateur pour un élément

SPi = valeur de la réponse sélectionnée par le PS pour un élément

n = nombre d'éléments dans la partie PS du cas

| Info | ||

|---|---|---|

REMARQUES :

|

Image Added

Image Added

Valeur d'accord de section

La valeur de différence est utilisée pour calculer la valeur de l'accord de section.

Cette valeur en pourcentage se réfère à une section de la partie PS et correspond à la différence entre la valeur totale des points non ouverts réalisables dans la section et la valeur de différence, divisée par la valeur totale des points réalisables.

| Info |

|---|

La valeur d'accord de section est une valeur en pourcentage qui se réfère à une section de la partie PS : il s'agit de la différence entre la valeur totale des points non ouverts réalisables dans la section et la valeur de la différence, divisée par la valeur totale des points réalisables. |

Image Added

Image Added

t = valeur totale des points réalisables sans limite de durée dans la section

d = valeur de la différence pour la section

À partir de la valeur d'accord de chaque section de la partie PS, le système calcule la valeur d'entente entre évaluateurs : leur moyenne pondérée en utilisant les pondérations de section telles que définies dans le gestionnaire de cas pour la notation de l'apprenant.

Cela permet de s'assurer que les désaccords sur les points des sections les plus importantes (donc les plus pondérées) affecteront davantage la valeur d'accord totale.

Valeur d'entente entre évaluateurs

Valeur d'entente entre évaluateurs : somme des résultats de chaque valeur d'entente de section dans une partie particulière du PS et de la pondération de la section correspondante, divisée par la somme des pondérations de la section.

Image Added

Image Added

ss = valeur d'accord de section pour chaque section de la partie PS d'un cas donné

ws = pondération de la section appartenant à chaque section de la partie PS, définie dans le gestionnaire de cas

n = nombre de sections dans la partie PS

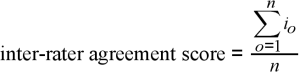

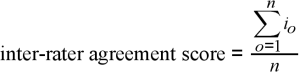

Note d'entente entre évaluateurs

La valeur d'entente entre évaluateurs se réfère à une observation du PS sur sa performance pour une certaine rencontre avec l'apprenant.

Cependant, les PS peuvent être évalués sur la base de plusieurs observations dans un cas.

La note totale d'entente entre évaluateurs est une moyenne des valeurs d'entente entre évaluateurs de toutes les observations du PS pour un cas donné.

Image Added

Image Added

io = valeur d'entente entre évaluateurs d'un PS, pour une rencontre particulière (c.-à-d. une observation)

n = nombre d'observations du PS pour un cas donné

| Info | ||

|---|---|---|

|

Inter-Rater Agreement Score

The Inter-Rater Agreement Value refers to one observation the SP has about their performance for a certain learner encounter. However, SPs may be evaluated according to several observations in a Case.

The total Inter-Rater Agreement Score is an average of the Inter-rater Agreement Values from all observations of the SP for a certain Case.

Image Removed

Image Removed

io = inter-rater agreement value of an SP, for one particular encounter (i.e. observation)

n = number of observations the SP has for a certain Case

| Info | ||||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| ||||||||||||

|

| Tip |

|---|

For further information, see the Reports - How to pages and the Reports Module Training VideosPour plus d'informations, voir les pages Rapports - Comment faire et les vidéos de formation du module Rapports. |